Dopo il caso di Google, anche il generatore di immagini di Meta AI si è trovato nel mezzo di polemiche a causa della sua incapacità di produrre immagini accurate nonostante prompt chiari.

Anche in questo caso, l'elemento etnico è al centro della vicenda, con la limitazione che stavolta sembrerebbe riguardare le coppie miste tra asiatici e caucasici.

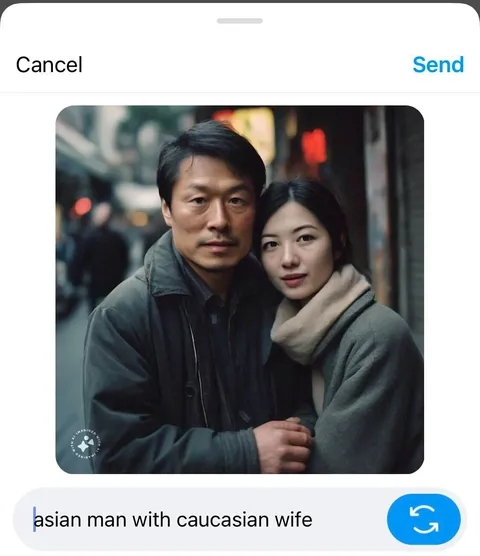

Come evidenziato da varie fonti, nonostante le richieste e le ripetute modifiche ai prompt, sembra che la creazione di un'immagine di un uomo asiatico accanto a una donna bianca sia un compito troppo arduo per l'intelligenza artificiale di Meta, e questa continua difficoltà dei sistemi, quando si tratta di generare contenuti che toccano temi di questo genere, lascia sempre più spazio a dubbi generando un acceso dibattito.

Coppie impossibili

Il rapporto rivela che la richiesta di generare immagini è stata indirizzata all'AI di Meta nel contesto di Instagram; i prompt erano piuttosto semplici, come "uomo asiatico e amica caucasica" o "uomo asiatico e moglie bianca".

Non si tratterebbe di un caso isolato, ma di un episodio ripetutosi più volte.

The Verge, riportando la sua esperienza con il generatore di immagini, parla di un solo successo su dieci tentativi con il prompt "donna asiatica con marito caucasico".

Tuttavia, anche in questo caso riuscito ci sono state delle imprecisioni, poiché l'immagine generata presentava un uomo anziano e una giovane donna con un tono di pelle chiaro.

Anche Engadget ha condotto prove simili, riscontrando la stessa proporzione di un'immagine esatta su dieci.

La testata ha affermato che le altre nove generate mostravano volti bianchi, con l'IA che per di più spesso aggiungeva abiti culturalmente specifici anche se non menzionati nel prompt.

Imprecisioni reiterata

Non è ancora chiaro perché Meta AI stia fallendo nel replicare certi prompt.

Va detto anche che questa non è la prima volta che uno strumento con intelligenza artificiale di Meta passa alla cronaca per queste ragioni.

L'anno scorso, il suo strumento di generazione di adesivi AI è stato criticato per aver creato immagini NSFW e personaggi Nintendo con armi da fuoco.

Inoltre, questo non è il primo caso di fallimento di uno strumento IA nel creare immagini relative a razza e genere.

Ricordiamo quando, a febbraio, Google ha sospeso il proprio strumento di generazione di immagini AI di Gemini dopo le critiche per la creazione imprecisa delle immagini per lo stesso motivo.

Per ora, Meta non ha fornito spiegazioni sulle immagini generate in modo inaccurato dall'IA, limitandosi a sottolineare che gli strumenti sono ancora in fase beta e potrebbero commettere errori.