Ospite attesissima della GPU Technology Conference 2016, NVIDIA ha finalmente presentato in via ufficiale la tecnologia Pascal, quella basata su transistor FinFET 16nm che troveremo nella prossima generazione di GeForce, ma lo ha fatto in modo a dir poco inaspettato. La nuova architettura della regina delle GPU discrete si è mostrata attraverso il chip Tesla P100 il cui destino, per ora, è quello di finire nei datacenter e, nello specifico, in un super computer studiato per il deep learning. Il DGX-1 impacchetta 8 chip Tesla, costa 129.000 dollari e, almeno per ora, non c'entra quasi nulla con i videogiochi anche se ci fornisce una prima misura dell'avanzamento tecnologico intrapreso da NVIDIA con la tecnologia Pascal. Rispetto alle soluzioni similari presentate lo scorso anno, caratterizzate da 4 GPU Maxwell, il DGX-1 monta 16GB di memoria HBM2, sfoggia una capacità di calcolo 12 volte superiore, riesce a macinare qualcosa come 1.33 miliardi di immagini al giorno e promette di rivoluzionare l'intelligenza artificiale anche grazie a nuove tecnologie dedicate alle reti neurali.

Com'è ovvio che sia queste tecnologie non si limiteranno alla gestione dei dati e alle auto intelligenti, ma avranno un'influenza importante anche sul cloud computing e, di conseguenza, sul gioco via streaming ma come abbiamo detto parliamo comunque di qualcosa che con il gaming, almeno per ora, centra solo marginalmente. Eppure, superata l'inevitabile delusione del mancato appuntamento con la fantomatica GeForce GTX 1080, quello che abbiamo per le mani può comunque alimentare i sogni di noi videogiocatori. D'altronde possiamo presumere che il Tesla P100 sia la base o comunque un parente prossimo di quella GPU, attualmente identificata come GP100, che troveremo nelle future Ti e Titan. Per questo siamo decisamente interessati alle specifiche di questo chip che includono conferme importanti come il raddoppio dei transistor rispetto al top di gamma Maxwell e l'impiego di memorie HBM2. Qua e la ci sono alcuni dati che non collimano con le aspettative ma questi possono dipendere dalla particolare natura della GPU che si spinge a frequenze elevatissime, addirittura 1480 MHz in modalità turbo, e forse proprio per questo può arrivare a consumare 300W superando nettamente i 250W della GTX 980 Ti. Inoltre c'è il massiccio die da 610mm2 che segna un record superando per area occupata anche i 601mm2 del generoso GM200 utilizzato nella Titan X e nella GTX 980Ti. Le dimensioni di quest'ultimo, però, potrebbero essere giustificate dal massiccio incremento dei transistor che non sono esattamente la metà, in termini di miniaturizzazione, di quelli a 28 nanometri. Non a caso c'è già chi da per scontato l'utilizzo dello stesso die anche con il chip GP100, che sotto alcuni aspetti potrebbe superare le specifiche del Tesla P100. Le informazioni disponibili parlano infatti di 60 Shader Module contro 56, e di 3840 CUDA Core contro 3584.

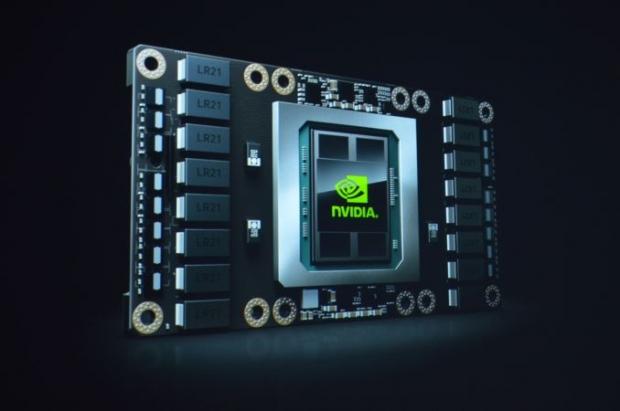

La prima GPU NVIDIA Pascal si è presentata con un biglietto da visita da 15.3 miliardi di transistor

Un balzo deciso verso il futuro

Tenendo conto di quanto sopra ed eliminando la tecnologia NVLink, la promettente interfaccia NVIDIA per ora dedicata esclusivamente a soluzioni come il summenzionato DGX-1, quello che ci resta per le mani al momento è un chip con 3.584 CUDA Core e 15.3 miliardi di transistor contro i 3072 CUDA Core e gli 8.1 miliardi di transistor del GM200 montato su GTX Titan X e GTX 980 Ti. Quali che siano le differenze con il futuro GP100, il salto in termini di potenza bruta è comunque netto con 10.6 TFLOPS di capacità di calcolo single precision contro i 5.6 della GTX 980 Ti e i 6.2 della Titan X. A questo punto, ribadendo che il numero di operazioni per secondo è solo uno dei fattori determinanti per il potenziale di una scheda, possiamo limitarci a constatare che il primo chip Pascal sembra mantenere tutte le promesse e le premesse con cui ci siamo dilettati in questi lunghi mesi di attesa. Il salto prestazionale imponente, lo sappiamo, è dovuto anche alla lunga permanenza del processo a 28 nanometri che ha determinato il salto dei 20 e quindi il passaggio diretto ai 16, ma in questo frangente a spingere l'escalation delle performance concorre anche la necessità di rispondere alle crescenti richieste hardware delle nuove tecnologie video.

Tecnologie di grande interesse per NVIDIA come conferma un'apertura della conferenza di San Josè tutta dedicata all'ottimizzazione della realtà virtuale, un obiettivo inseguito con la suite VRWorks e con funzioni specifiche come VR SLI, Context Priority e Multi-Res Shading. Il tutto condito con un tour virtuale dedicato all'Everest e con una ricostruzione di Marte provata per la prima volta in versione VR da Steve Wozniak, che speriamo non abbia bisogno di presentazioni. Purtroppo a far girare le due impressionanti demo mostrate sul palco della GTC 2016 (le trovate nel video allegato all'articolo) ci ha pensato una Titan X e questo dettaglio esclude la presenza di una GeForce GTX Pascal dietro le quinte. Se a questo ci aggiungiamo il ritardo della presentazione delle nuove GeForce non può che sorgere qualche dubbio sull'effettiva possibilità di vedere le nuove schede video NVIDIA sul mercato in occasione del Computex che si terrà tra fine maggio e inizio giugno. Ma c'è un dettaglio menzionato nella prima parte della conferenza che ci rassicura. Jen-Hsun Huang, l'ormai familiare CEO della compagnia, ha confermato che il rilascio dell'upgrade 8 della piattaforma CUDA, ovvero la prima versione compatibile con GPU Pascal, avverrà nel mese di giugno. Inoltre dobbiamo considerare che il Tesla P100 è già in produzione effettiva. I chip arriveranno ai partner a giugno e compariranno nelle reti di distribuzione capillare a inizio 2017. Questo significa che NVIDIA può già sfornare le nuove GeForce e può farlo anche montandoci sopra memorie HBM2 anche se per ora una banda passante da 4096-bit serve a poco e, non a caso, è quasi certo l'impiego delle GDDR5X per le schede di fascia media e alta della serie Pascal. Il dato rilevante, comunque, resta l'arrivo a breve di schede video che puntano senza mezze misure alle risoluzioni Ultra HD e alla realtà virtuale pienamente fruibile anche con motori grafici esosi. L'unico grosso dubbio che ci resta, a meno che NVIDIA non decida di svalutare brutalmente tutta la serie Maxwell, riguarda il prezzo di questo balzo verso il futuro che potrebbe rivelarsi piuttosto elevato.

Per conoscere i dettagli della nostra policy editoriale, è disponibile la pagina etica.