Qualche giorno fa, Multiplayer.it è stata invitata a Parigi negli uffici di Quantic Dream, lo sviluppatore francese che ha creato giochi come Heavy Rain e Detroit: Become Human, e che ora sta lavorando a Star Wars: Eclipse. Durante la visita c'è stata occasione di conoscere meglio il team di sviluppo e i suoi 25 anni di storia, raccontati in un altro articolo su queste pagine che ripercorre passato, presente e futuro della compagnia. In quest'occasione voglio raccontarvi invece più nello specifico degli strumenti che usa Quantic Dream per sviluppare i suoi giochi, dal momento che all'interno dei loro uffici si trovano alcune delle tecnologie più avanzate in Europa quando si tratta di realizzare e animare personaggi in 3D.

Motore e tool di sviluppo

A differenza di molti altri studi di sviluppo, sono 25 anni che Quantic Dream crea internamente le sue tecnologie e i suoi tool. Fin dal suo primo gioco, Omikron: The Nomad Soul, l'azienda ha sviluppato un suo motore grafico proprietario, andando via via a espanderlo e ad aggiornarlo per renderlo tecnicamente al passo coi tempi. Per giochi come Fahrenheit: Indigo Prophecy e Detroit: Become Human, il motore venne rivoltato come un calzino e rifatto da zero, mentre in vista di Star Wars: Eclipse gli ingegneri in Quantic Dream stanno continuando ad aggiornarlo per supportare tecnologie più moderne come il Ray Tracing.

In base alle esigenze dei vari sviluppatori vengono realizzati anche dei tool di sviluppo più mirati. Per esempio, Popcorn è il nome dello strumento utilizzato dal gruppo che si occupa delle cinematiche, con cui possono cambiare al volo lenti di ripresa, framerate, inquadrature ed effetti di luce. Un altro strumento proprietario si chiama Feather ed è l'interfaccia che permette ai narrative designer di controllare i dialoghi e i vari rami della storia: volendo si possono testare pezzi di gioco come fossero delle avventure testuali, e intervenire rapidamente nei testi e nelle conseguenze che scelte e risposte hanno sui personaggi.

Marionette animate

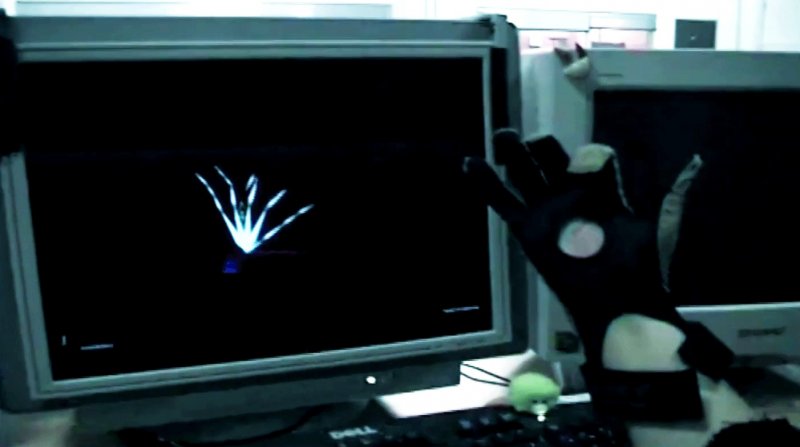

Discorso simile vale per gli strumenti che Quantic Dream utilizza per realizzare il motion capture e portare gli attori all'interno dei suoi giochi. Le tecnologie che usa si sono evolute e sono cambiate negli anni. Ai tempi di Farhenheit: Indigo Prophecy, le animazioni facciali dei personaggi erano controllate da un marionettista che aveva dei guanti con dei sensori. A ogni dito del guanto era assegnata un'animazione facciale del personaggio e così, muovendo le dita, si poteva passare in tempo reale da un'espressione all'altra mentre si registravano le cinematiche. Chiaramente questo aveva dei limiti: anzitutto il numero di dita, perché con due guanti potevi gestire un numero limitato di espressioni per volta.

Le animazioni erano inoltre come degli interruttori acceso/spento: non era possibile avere variazioni più o meno esagerate o passare da un'espressione all'altra in una maniera che sembrasse naturale, per quanto il risultato ottenuto fu comunque sopra gli standard di quei tempi. Altro limite pratico era la necessità di una persona in più che si occupasse solo delle espressioni facciali, in aggiunta a quella che realizzava il doppiaggio e a tutti i diversi attori e stuntman coinvolti per registrare le scene d'azione e i movimenti.

Oggi si usa un metodo diverso per catturare le espressioni, e sul volto degli attori vengono attaccati tanti piccoli marker, minuscole sfere metalliche che riflettono la luce e permettono il tracciamento dei muscoli del volto.

La sala del motion capture

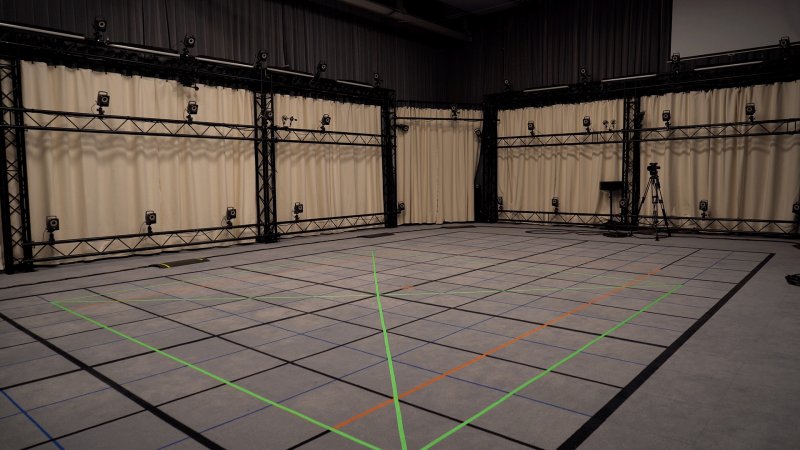

Quantic Dream costruì la sua sala per il motion capture nel 2000 proprio per lo sviluppo di Farhenheit. Oggi in questo spazio 11 x 6 metri sono posizionate un'ottantina di telecamere in grado di catturare le performance degli attori a 360°. Negli anni è cambiata l'attrezzatura, ma soprattutto è cambiata anche la grandezza dell'area in cui si riesce a tracciare il motion capture. Ai tempi di Heavy Rain e di Beyond: Due Anime, lo spazio in cui si muovevano gli attori era molto più piccolo rispetto a quello disponibile per Detroit: Become Human.

Questi confini vengono delimitati con del nastro adesivo colorato, e il colore serve sia agli attori, che non devono superare certe aree, sia ovviamente serve per calibrare le telecamere. All'inizio di ogni nuovo progetto, il nastro adesivo vecchio e consumato viene sostituito, e qui Quantic Dream ha un suo strano rituale: anziché buttare il nastro, gli sviluppatori lo attaccano a una palla fatta coi nastri dei vecchi progetti. Questa sfera oggi è enorme, assomiglia a una palla da beach volley ma pesa forse più di una palla da bowling, e anche se non è particolarmente bella da vedere è un cimelio che in qualche modo si porta dietro tutta la storia dei progetti che sono stati realizzati in quella sala.

La sala del motion capture di Quantic Dream è divisa in due. Metà è il palcoscenico, dove ci sono le telecamere e gli attori, mentre l'altra è l'area con scrivanie e computer dove i membri del team di sviluppo supervisionano le riprese per essere sicuri che sia tutto perfetto. Questa seconda area funziona anche da ripostiglio, visto che lì vengono conservati tutti gli oggetti di scena. Alcuni di questi oggetti possono essere utilizzati in modi diversi: c'è stato mostrato uno strumento a forma di boccale, che a seconda di come viene orientato può trasformarsi in oggetti completamente diversi. In Detroit è stato utilizzato ad esempio come una tazza, una torcia elettrica e un megafono.

Su una rastrelliera ci sono poi tutte le armi: pistole, fucili di diverso tipo, ma anche spade, bastoni e katane. Ovviamente le armi sono finte e sono coperte da marker e nastri colorati in modo che le telecamere possano tracciarle. Però anche qui ci è stato raccontato un aneddoto curioso e che riguarda il peso delle armi. Alcune pistole hanno un peso realistico, pesano quanto una pistola vera, mentre altre sono invece identiche nella forma ma molto più leggere, come delle pistole giocattolo. Per Detroit è stato importante avere entrambe le versioni dell'arma, perché se da un lato la pistola più pesante rende la performance e i movimenti dell'attore più credibili, dall'altro è pur vero che gli androidi del gioco non sentono il peso, non fanno fatica a sollevare oggetti, quindi è importante che i movimenti degli attori siano fluidi e leggeri anche dopo ore di riprese.

Una curiosità riguarda il motion capture degli animali, come ad esempio le scene in cui ci sono dei cavalli o dei cani: in questi casi Quantic Dream preferisce spostare l'attrezzatura necessaria nei luoghi in cui si trovano gli animali, sia per non maltrattarli, sia ovviamente per non rischiare che venga devastata la sala. Ingrid Sanassee, responsabile delle animazioni dei personaggi, ci ha raccontato che di tanto in tanto il team di animatori si diverte a sperimentare con i dati raccolti nei modi più assurdi: durante lo sviluppo di Detroit, presi dalla curiosità, hanno assegnato al modello 3D di Connor i mokit creati per i piccioni all'interno del gioco, divertendosi a vedere il protagonista svolazzare in posizioni assurde. "Questa roba non finisce praticamente mai all'interno dei giochi", ci ha raccontato. "Però è sempre divertente vedere cosa succede, e ogni tanto impari qualcosa di nuovo su quello che fai".

Guardarsi attorno nella stanza del motion capture di Quantic Dream fa una strana sensazione. Da un lato è un ambiente completamente vuoto e con delle telecamere attorno, uno spazio impersonale senza particolari attrazioni. Dall'altro si ripensa ai giochi di Quantic Dream e ci si rende conto che quello stesso spazio negli anni si è trasformato in un'infinità di ambientazioni differenti: tra i mille scenari è stato un albergo, una prigione, un centro commerciale, una stazione di polizia o una strada di una città americana.

Collaborazioni

La stanza del motion capture di Quantic Dream è tra le più grandi e all'avanguardia in Europa. Per questo motivo, Quantic Dream mette a disposizione la sua attrezzatura e i suoi spazi anche ad altre compagnie nell'industria dell'intrattenimento. In questa stanza Asobo Studio ha realizzato il motion capture per A Plague Tale, Square Enix ha girato cinematiche legate a Final Fantasy e Bandai Namco ha dato vita al primo trailer di Elden Ring. Anche Netflix ha usato questi stessi spazi per alcuni episodi di Love, Death & Robots.

Creare il personaggio 3D

Il director Benjamin Diebling ci ha spiegato che uno dei limiti attuali del motion capture è l'impossibilità di vedere in tempo reale come apparirà la scena che hai girato all'interno del gioco: "Quando giri una scena di un film puoi vedere immediatamente la ripresa con gli attori all'interno della scenografia. Con i videogiochi non è così, e dopo che hai girato in motion capture il tuo lavoro passa nelle mani degli artisti. Un passo avanti importante nel settore sarebbe proprio questo: vedere immediatamente il risultato finale tra un ciak e l'altro".

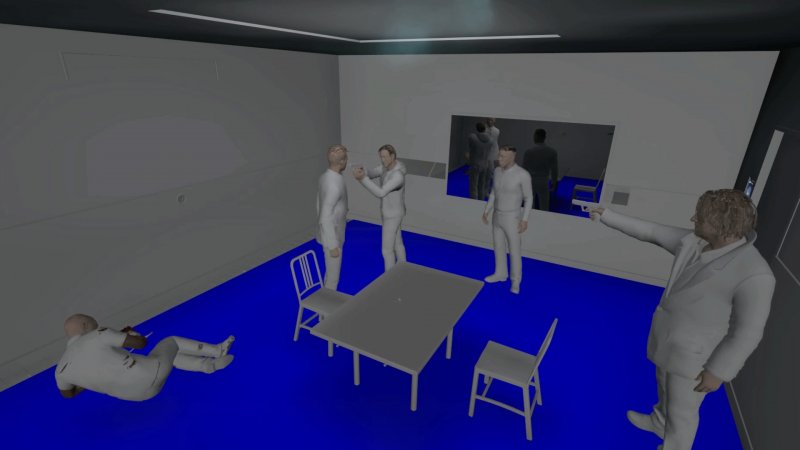

Se non si fosse ancora capito, quello che viene catturato grazie al motion capture sono, come si intuisce dal nome, i movimenti. Che siano i movimenti del corpo o le espressioni facciali, tutte queste informazioni da sole non portano al personaggio finito; servono invece a quello che in gergo viene chiamato "rigging del personaggio", ovvero quel procedimento che permette di avere uno scheletro articolato, una specie di marionetta su cui poi va applicato il modello 3D che si vuole animare.

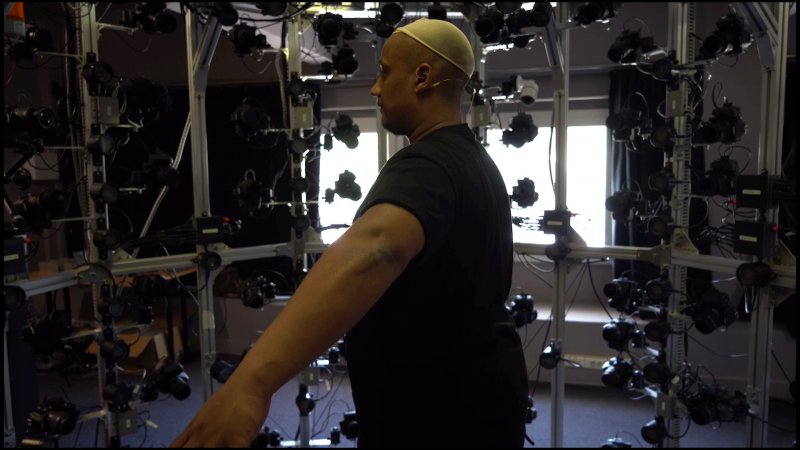

Il modello 3D si crea quindi a parte, e da diversi anni anziché modellare i personaggi partendo da zero, sviluppatori come Quantic Dream fanno direttamente una scansione 3D del volto e del corpo degli attori. Per tanti anni, per fare la scansione degli attori il team di sviluppo ha usato degli scanner 3D portatili: assomigliano a una specie di ferro da stiro con un sistema di luci e di telecamere. Le telecamere rilevano la superficie di un oggetto in base a come si deforma la luce, e dai dati ricevuti ottiene le coordinate 3D nello spazio. Gli scanner portatili finora hanno funzionato molto bene, ma dal 2021 Quantic Dream ha fatto un ulteriore passo in avanti allestendo una gabbia per la fotogrammetria.

Si tratta di un piccolo spazio su cui sono puntate 149 fotocamere, molte delle quali hanno un obiettivo lungo in modo tale da catturare i più piccoli dettagli. Si entra in questa gabbia e si resta immobili mentre un tecnico dalla sua postazione scatta le foto che poi vengono inviate a un software che crea una nuvola di punti che a sua volta rappresenta la base di partenza del modello 3D. Concettualmente il funzionamento è simile a quello degli scanner usati finora, ma il nuovo sistema oltre a essere più preciso ha anche un vantaggio pratico. Visto che le foto vengono scattate contemporaneamente da ogni angolazione, non c'è bisogno che qualcuno giri continuamente con lo scanner attorno all'attore.

Ci sono però tutta una serie di dettagli da tenere in considerazione prima di procedere: anzitutto bisogna avere un'altezza precisa (a meno di non voler ricalibrare tutte le volte le telecamere), quindi in un angolo della stanza vengono tenute delle piattaforme in legno di diverse dimensioni su cui, eventualmente, far salire gli attori. Poi, è fondamentale che la stanza sia al buio e che non si indossino occhiali, collane oppure oggetti che riflettono la luce, per evitare che si creino delle macchie nella scansione. Il risultato di questa scansione, grezzo e non ritoccato, è un modello che Quantic Dream dice aggirarsi tra i 40 e i 50 milioni di poligoni, e che quindi va a catturare ogni minimo dettaglio. Prima di poterlo inserire in un gioco, ovviamente questo modello va ripulito e va creata una mesh 3D che sia più leggera e con un numero di poligoni molto inferiore. Giusto per darvi un'idea, il modello di Kratos nell'ultimo God of War aveva 80.000 poligoni per il corpo, di cui 30.000 poligoni per la testa, mentre un'auto in Gran Turismo 7 arriva a 500.000 poligoni.

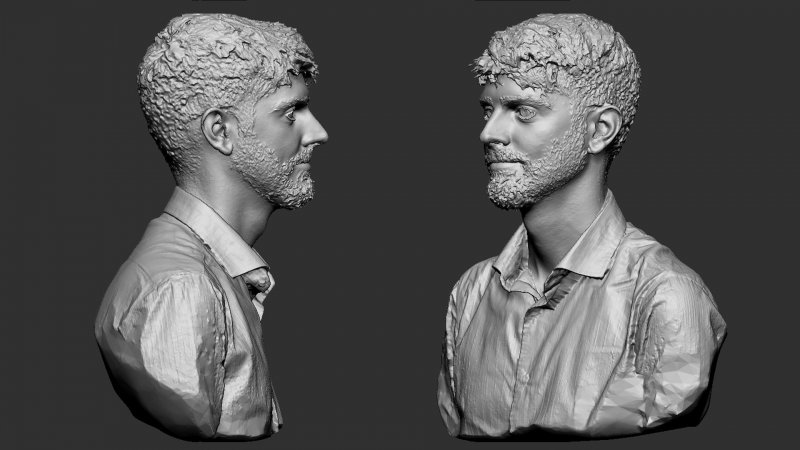

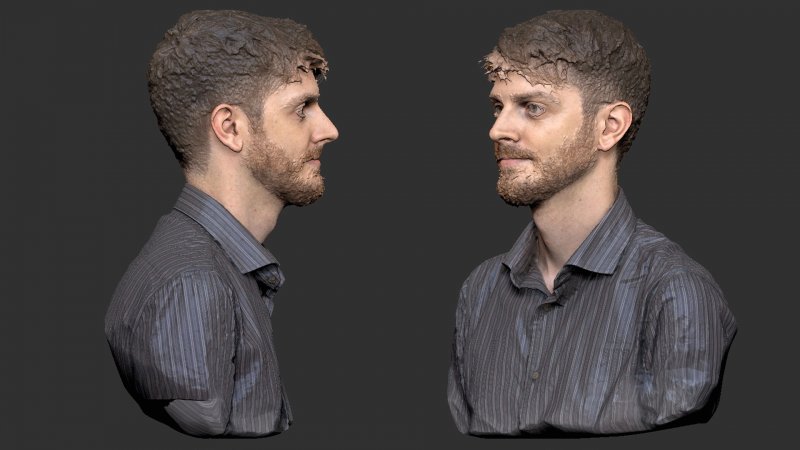

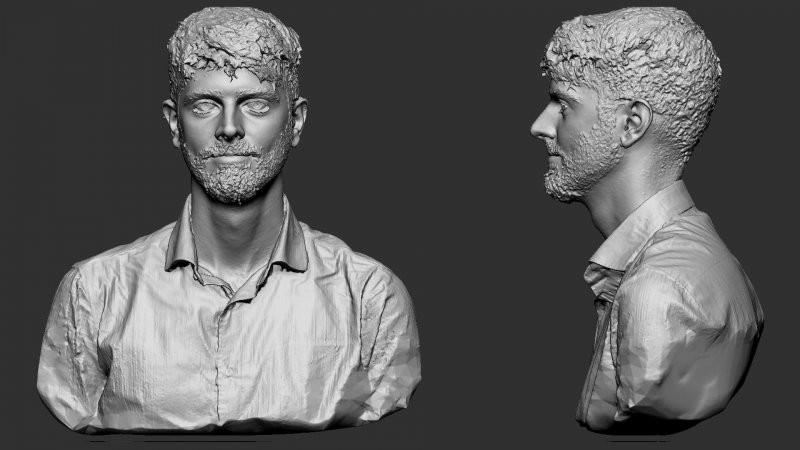

Per avere una dimostrazione pratica, Quantic Dream mi ha permesso di provare la gabbia della fotogrammetria, inviandomi successivamente il risultato della scansione.

Ripresi dallo spavento? Bene. A parte gli incubi che avrete stanotte, il risultato è interessante perché fa notare un paio di cose. In generale la scansione ha un livello di dettaglio impressionante nella conformazione del volto, nelle imperfezioni della pelle, le texture e le pieghe della camicia che forse, a ben pensare, sarebbe stato il caso di stirare. Dove invece è tutto impasticciato è nei capelli e nella barba, tutti elementi che in molte occasioni nemmeno vengono scansionati nelle sessioni di fotogrammetria. Agli attori spesso si chiede di radersi la barba e di indossare una cuffia o un cerchietto per tirare su i capelli, perché l'importante è avere una scansione quanto più precisa del volto e dei lineamenti, mentre capelli, baffi e barba vengono solitamente aggiunti al modello del personaggio dai grafici del team.

Ci sono poi altri ovvi motivi per cui il risultato è ben lontano dalla qualità dei personaggi di Detroit o di produzioni più recenti come Death Stranding e Horizon: Forbidden West. Come detto, le scansioni 3D degli attori passano attraverso una fase di cleanup, in cui gli artisti lavorano alla mesh 3D, sistemano le texture e i dettagli. Questa scansione è stata invece realizzata come semplice dimostrazione e con un singolo scatto, mentre le sessioni di fotogrammetria con gli attori possono durare decisamente più tempo.

Queste tecnologie saranno impiegate chiaramente per i prossimi progetti di Quantic Dream, a partire da Star Wars: Eclipse. Vista l'evoluzione continua degli strumenti del team di sviluppo sarà interessante vedere se tra Detroit ed Eclipse ci sarà quello scarto tecnico enorme che abbiamo visto passando da Fahrenheit a Heavy Rain oppure da Heavy Rain a Beyond.

Per conoscere i dettagli della nostra policy editoriale, è disponibile la pagina etica.