Nel corso dell'ultima conferenza ISSCC 2026 di San Francisco, NVIDIA ha mostrato un chip progettato per un compito preciso: riconoscere la presenza di un volto umano quasi istantaneamente e con un consumo energetico estremamente ridotto. Il prototipo, chiamato Alpha-Vision, completa l'operazione in 787 microsecondi, meno di un millisecondo.

Il dato più rilevante riguarda l'efficienza: il consumo resta sotto i 5 milliwatt, una frazione rispetto ai circa 10 watt richiesti da sistemi di visione artificiale tradizionali. Il risultato è un cambio di prospettiva per l'uso continuo della visione su dispositivi alimentati a batteria.

A cosa serve il chip Alphavision di NVIDIA

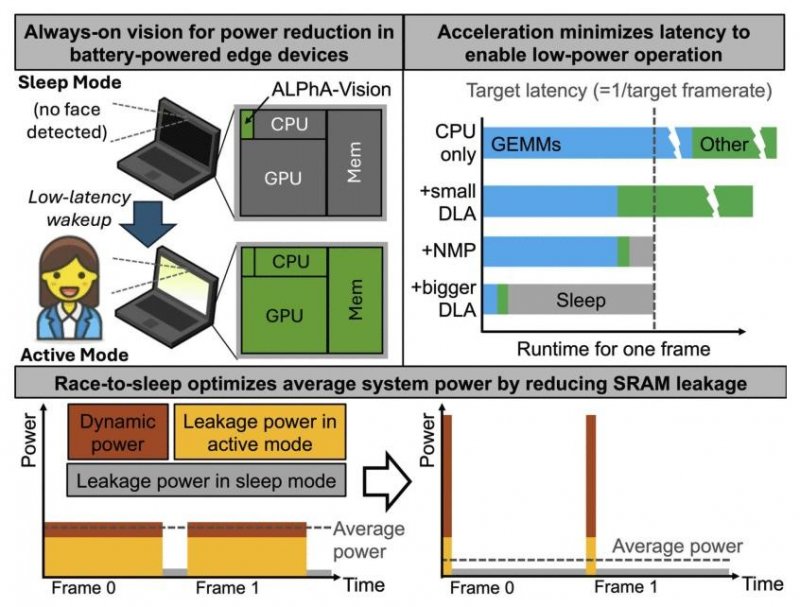

L'idea di una visione artificiale sempre attiva non è nuova, ma finora si è scontrata con limiti energetici evidenti. Notebook, telecamere e sistemi di sicurezza già integrano funzioni simili, ma mantenerle operative in modo costante incide sull'autonomia. Alpha-Vision affronta il problema con un approccio diverso, basato sul principio definito "race to sleep".

Il funzionamento è diretto: il chip esegue l'inferenza il più rapidamente possibile e resta inattivo per la maggior parte del tempo. In uno scenario a 60 fotogrammi al secondo, dove ogni frame dura 16,7 millisecondi, il chip utilizza circa il 5% della finestra temporale per analizzare l'immagine. Il restante tempo viene trascorso in uno stato di consumo quasi nullo grazie al power gating. L'accuratezza dichiarata raggiunge il 99%, sufficiente per distinguere la presenza di un volto senza identificarlo.

Per sostenere questa velocità, i dati necessari al modello neurale vengono conservati direttamente su memoria SRAM integrata. Si tratta di circa 2 MB che contengono i parametri della rete, non immagini o database di volti. Questo elimina la latenza legata alla memoria esterna, ma introduce un problema noto: la dispersione energetica dei transistor, che aumenta con la dimensione della memoria.

La soluzione consiste nell'applicare la stessa logica di spegnimento rapido anche alla SRAM. Mantenendo attiva la memoria solo per poche centinaia di microsecondi, la perdita energetica complessiva diventa trascurabile su base temporale. Il risultato è reso possibile da tre fattori maturati negli ultimi anni: modelli neurali più compatti grazie a tecniche come quantizzazione e pruning, acceleratori hardware ottimizzati per l'inferenza a bassa potenza e sistemi di gestione energetica capaci di attivare e disattivare singoli blocchi in tempi estremamente ridotti.

Alpha-Vision supporta sia reti convoluzionali sia Vision Transformer, rendendolo adattabile a diversi compiti visivi. Il rilevamento dei volti è solo un esempio, ma le applicazioni potenziali includono laptop, sistemi di videoconferenza, dispositivi IoT e sensori per veicoli autonomi, dove è utile sapere se una persona è presente senza attivare sistemi più complessi.

Per conoscere i dettagli della nostra policy editoriale, è disponibile la pagina etica.